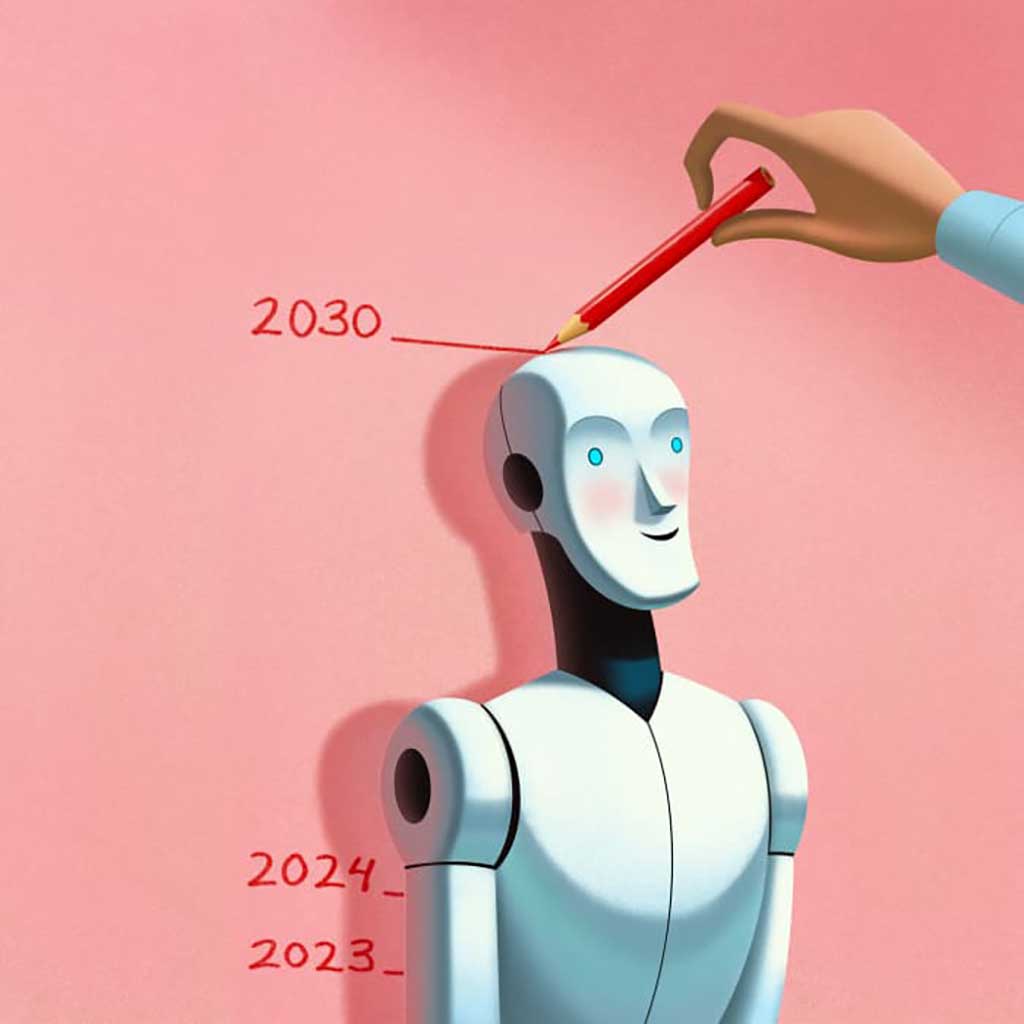

到2030年,人工智能(AI)将会发展到什么程度?

AI会不负众望,促进经济发展、创造突破性医疗方案、简化日常生活并增加我们的知识吗?还是说,这些预测过于乐观了:AI会失败,会让世界变得更糟?人们担心AI会取代数以百万计的工作岗位、取代人际关系,并以虚假媒体的猛烈攻势来挑战社会,该如何看待这些担忧呢?

《华尔街日报》(The Wall Street Journal)采访了来自学术界、商界、咨询公司和智库的专家,请他们预测到2030年AI将发展到什么程度?以下是一些预测。

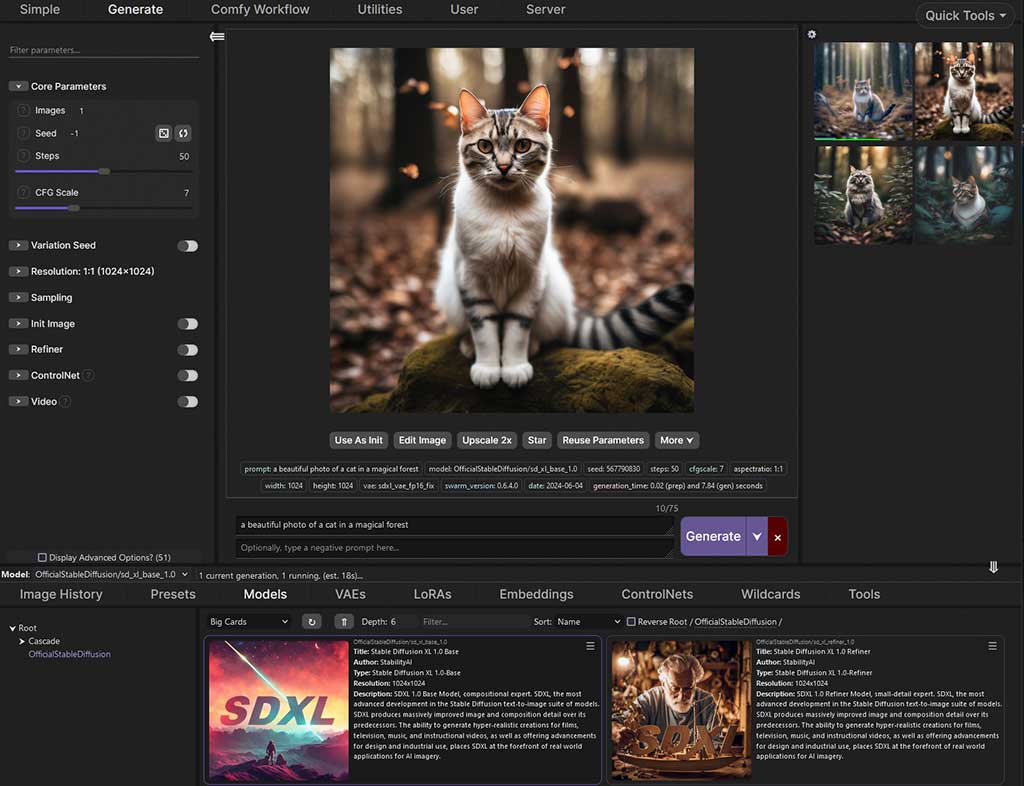

Stable Diffusion 是一种生成人工智能模型,可以根据文本和图像提示生成独特的逼真图像。Stable Diffusion和ChatGPT、Midjourney是AIGC应用快速体验推荐的应用,也与 Meta Llama 3 一起作为开源人工智能模型的代表。

SwarmUI(以前称为 StableSwarmUI)是Stable Diffusion官方推出的一款WebUI框架,致力于易于访问、高性能和可扩展性,可以在Windows、Linux及Mac 电脑及 Docker 上运行(《AIGC应用快速体验》一文中有更多Stable Diffusion用户界面的介绍),支持Stability AI自家的SD 1.5、SDXL、SD3、Stable Cascade,以及 Black-Forest-Labs FLUX 模型,Black-Forest-Labs拥有开发第一个Stable Diffusion的原始开发人员。